在 00 后的世界里,电和空气与水一样,理应取之不尽,用之不竭。

" 不解 " 背后,还有很多的 " 不知 "。

在人们眼里,电力的消耗似乎主要来自生活用电和钢铁等传统第二产业,可全然不知的是,代表 " 更轻、更快、更绿色 " 的科技领域,正在成为电力消耗的主角。

以芯片制造企业台积电为例,其一年共耗电 143.3 亿度,相当于深圳市 1344 万常住居民一年的用电量。

同时有一个令人震惊的数字是,全球比特币挖矿年耗电量约为 1348.9 亿度,超过瑞典整个国家的用电总和,经换算后,可在全球国家耗电量中排名 27 位。

此外,各大互联网巨头的数据中心,也是名副其实的 " 电老虎 "。

科技纵使为社会带来了高效和便利,但在很多看不到的地方,存在着巨大的电力浪费。

(一)" 吃掉 " 三峡大坝和葛洲坝的数据中心

近年来,随着云计算、人工智能、大数据、物联网和移动互联网的深入发展,数据中心一方面步入快速发展阶段。

但是,另一方面,数据中心又面临能耗过高的问题。

华为负责研究可持续信息和通信技术安德斯 · 安德雷曾表示,数据中心目前消耗了全球约 2% 的电力,到 2030 年可能上升到 8%。

从国内看,全国数据中心的耗电量已连续 8 年超过 12% 的速度增长。

2017 年,国内数据中心总耗电量达到 1200-1300 亿千瓦时,这个数字超过三峡大坝和葛洲坝电厂发电量之和(约 1000 亿千瓦时),而且预计 2025 年高达 3842.2 亿千瓦时。

在巨大耗电量的背后,还有着令人难以置信的浪费。

麦肯锡咨询公司透露,数据中心的耗电量仅有 6%~12% 是被用于网站计算的,其余均在维持服务器工作状态时被无谓消耗。随着互联网高速发展,这种耗电情况近年来持续走高。

同时," 过度散热 " 也是数据中心耗电巨大的重要原因。研究机构 Uptime Institute 曾对美国 19 个数据中心进行研究发现,数据中心的过度冷却差不多达到实际所需要的 2 倍。

此外,由于可再生能源的利用率低下,数据中心运转只能不断加大使用原始驱动力——电力,耗电量自然只增不减。

居高不下的耗电量、温室气体的排放、大量的水资源消耗和设备报废后的环境污染……数据中心数量与规模的快速增长已经为资源与环境带来巨大挑战,绿色数据中心的建设迫在眉睫。

(二)目前的节电手段——有效,但有限

面对数据中心的耗电局面,科技巨头们各自支招。

以腾讯为例,腾讯在贵州的贵安新区新建了一座数据中心——腾讯贵安七星数据中心,坐落于两座山的山体中。

腾讯贵州数据中心

该数据中心的设计规划为:山洞外冷空气从主洞口进入,经过制冷模块与 IT 设备热回风进行间接换热后,利用热气流自然向上的烟囱效应把热风从竖井排出。

这样既可以充分利用外部自然冷源,又避免了外界空气对设备的影响,提升了可再生能源的利用率。

此外,腾讯还利用余热回收技术,减少数据中心的能源消耗。

以腾讯天津数据中心为例,腾讯将数据中心的余热通过热泵机组进行升温,实现了绿色清洁的办公楼采暖。

仅一期余热回收项目,每年即可减少能耗标煤达 525 吨,相当于减少 1310 吨二氧化碳排放量,等效于种植 7.2 万棵树。

腾讯天津数据中心

再看阿里。

早在 2016 年,阿里云就推出了一款 " 凉得快 " 服务器。服务器被浸泡在一种特殊的绝缘冷却液里,运算产生热量可被冷却液直接吸收进入外循环冷却,全程用于散热的能耗几乎为零——这是一种高效的散热方式:浸没式液冷。

同年,阿里巴巴就在 " 风电之都 " 张北打造了两座绿色数据中心,采用了阿里云自主研发的飞天操作系统,可以将单集群上万台服务器连接成一台 " 超级计算机 ",用一半的电就能创造同等计算能力。

另外,阿里利用张北气温低、空气干净的优势,采用 " 新风自然冷技术 " 和 " 水侧自然冷技术 ",用自然冷源为服务器降温,全年大约只有 15 天的时间需要开启传统压缩机空调,仅制冷能耗就可以降低 59%。

数据中心新风自然冷系统

当然,我国科技巨头致力于 " 节能 ",外国科技巨头也如是。

比如,Facebook 将数据中心建在北极圈内,当地气温接近零下 50 度,外界的冷空气被泵进中心大楼内,服务器产生的大量热空气和进来的冷空气循环交换,形成自然冷却的过程。

又比如,微软将数据中心沉落海底。众所周知,世界上深海海水一直很冷,它可以为微软的数据中心提供随时且免费的高效冷却方式。

细心观察不难发现:科技巨头的种种措施都是为了利用自然冷源给数据中心提供更高的能效,减少制冷方面能耗的损失。

虽然科技巨头们加大利用自然冷源等思路是正确的,但是目前也只能降低一小部分的消耗。

如果在这个基础上,数据中心要 " 节能更大化 " 该何去何从?

(三)" 节能更大化 " 路在何方?

针对这个问题,浪潮数据中心业务技术负责人告诉雷锋网:" 主流的节能方法是 " 配电环节 " 和 " 制冷环节 ",但是由于配电环节已经相当成熟,提升空间有限。因此,节能的可操作性空间是在 " 制冷环节 "。

以浪潮 &LHAASO(高海拔宇宙观测站)合作为例,建立在 LHAASO 观测基地的稻城海子山数据中心海拔 4410m,是全球最高的数据中心之一。与标准大气压相比,4410m 海拔处,空气密度是原密度的 60%,常规风冷方式冷却效率降低 40%。低效率的风冷会造成芯片局部热点,导致芯片降频或者死机。

为此,浪潮采用冷板式液冷技术,通过液体冷却方式对芯片降温,使芯片低于临界安全温度 10~20 ℃安全稳定运行,不受海拔作用影响,提高能源利用率。

无论是腾讯在山里建数据中心,亦或是阿里的浸没式液冷,其实跟 LHAASO 的案例是一样的道理。虽然技术原理可能有区别,但究本质都是利用自然冷源,提升能源利用率,减少用电消耗。

浪潮数据中心业务技术负责人进一步补充道:" 节能最大化,根本上需要技术的不断迭代,节能技术要逐步解决运维复杂、操作复杂的问题,走向 " 好用 "、" 易用 ",从而降低数据中心的能源使用率。"

除了技术迭代,数据中心从东部沿海向西部内陆迁移也是 " 节能更大化 " 另一条好路。

前些年,大部分企业都是在业务丰富的东部地区建立数据中心。随着东部数据中心变得饱和,加上数据中心的建设审批变得更加严格,现在很多企业都会将部分数据中心建设在西部,利用西部地区的太阳能发电,这也能提高可再生能源的利用率。

浪潮数据中心业务技术负责人还告诉雷锋网 ( 公众号:雷锋网 ) :

当然,生态很关键。只有几家科技巨头发力节能,致力于碳中和作用是相对微小的。要打通行业上下游,整个产业链一起努力才能加速节能最大化。"

(四)生而畸形的 AI,跳不出耗电的死胡同

尽管科技巨头不断通过一些物理和工程手段去降低数据中心等平台的能耗,但从另外一方面来讲,企业所采用的部分技术,生而不具备绿色基因。

如当前人工智能的核心驱动技术深度学习,天生需要强大算力和强大功耗支撑,而且模型训练方法异常的粗暴。

现阶段的 AI,并不具备类似人类智慧一样举一反三和推理的能力,它的部分智能建立在 " 暴力计算 " 的基础之上。深度学习的研究内容很简单,就是罗列大量的数字进行运算。但这种方法无需通过颠覆性模式创新来实现,只需要提高算力,也就是堆芯片量即可。

2012 年 6 月,谷歌利用 16000 块芯片,让 AI 观看数百万段 YouTube 视频来识别出猫,即便如此仍错误百出,还不如人类眼睛的一瞥高效。

此外,2016 年 AlphaGo 击败围棋冠军李世石的人机大战中,AlphaGo 每局棋需消耗约 100 万瓦的电能,相当于一天约 100 户家庭的供电量。相比之下,人脑消耗的功率仅 20 瓦,只有 AlphaGo 的 5 万分之一。

真正公平的人机对战,应该在能耗等客观条件对等的情况,进行比拼,否则便跟背着火箭筒的五菱宏光跑赢法拉利超跑无异。

纵使机器超越了人,但显然很低效,也不绿色。

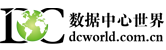

不仅仅是过往发生的事件反映了人工智能耗能巨大的问题,外国最新的论文结果也折射出相同的问题:平均一个 AI 大模型训练产生的能耗 = 五辆汽车一生排放的碳总量。

这篇新论文是马萨诸塞大学阿默斯特校区的研究人员公布的,以常见的几种大型 AI 模型的训练周期为例,发现该过程可排放超过 626000 磅二氧化碳,几乎是普通汽车寿命周期排放量的五倍(其中包括汽车本身的制造过程)。

对此结果,很多 AI 研究人员感到震惊。

西班牙拉科鲁尼亚大学的一位计算机科学家曾表示:" 虽然我们中的很多人对此(能耗)有一个抽象的、模糊的概念,但这些数字表明事实比我们想象得要严重。我或者是其他 AI 研究人员可能都没想过这对环境的影响如此之大。"

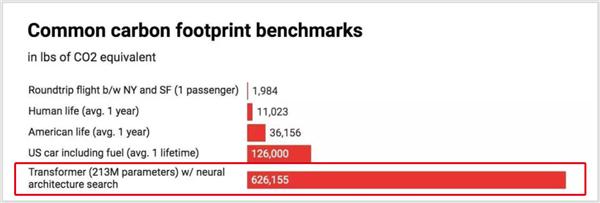

以自然语言处理为例,研究人员研究了该领域中性能取得最大进步的四种模型:Transformer、ELMo、BERT 和 GPT-2。研究人员在单个 GPU 上训练了至少一天,以测量其功耗。然后,使用模型原始论文中列出的几项指标来计算整个过程消耗的总能量。

结果显示,训练的计算环境成本与模型大小成正比,然后在使用附加的调整步骤以提高模型的最终精度时呈爆炸式增长,尤其是调整神经网络体系结构以尽可能完成详尽的试验,并优化模型的过程,相关成本非常高,几乎没有性能收益。

以 BERT 模型为例,其碳足迹约为 1400 磅二氧化碳,这与一个人来回坐飞机穿越美洲的排放量相当。

那么,为什么 AI 模型会如此耗电?

因为与人类的学习方式相比,AI 的训练效率非常低下。

现代 AI 使用人工神经网络,这是模拟人脑神经元的数学计算。每两个相邻神经元的连接强度都是神经网络上的一个参数,名叫权重。神经网络的训练则需要从随机权重开始,一遍遍地运行和调整参数,直到输出与正确答案一致为止。

常见的一种训练语言神经网络的方法是,从维基百科和新闻媒体网站下载大量文本,然后把一些词语遮挡起来,并要求 AI 猜测被遮挡起来的词语。刚开始的时候,AI 会全部搞错,但是,经过不断地调整后,AI 会逐渐学习数据中的模式,最终整个神经网络都会变得非常准确。

前文提到的 "BERT 模型 " ——基于变换器的双向编码器表示技术(Bidirectional Encoder Representations from Transformers,简称 BERT),这是一项由 Google 提出的自然语言处理(NLP)的预训练技术。

该模型使用了来自维基百科和其他文章的 33 亿个单词,而且在整个训练期间,BERT 读取了该数据集 40 次。相比之下,一个 5 岁的孩子学说话只需要听到 4500 万个单词,比 BERT 少 3000 倍。

之所以有以上这些强烈的对比是因为:

在开发模型期间,上述训练过程需要反复多次。因为研究人员需要将神经网络调整到最优,即确定神经元的个数、神经元之间的连接数以及各个权重。他们需要反复尝试很多组合,才能提高神经网络的准确度。然而,人类的大脑不需要寻找最佳结构,经过几亿年的进化,人类大脑已具备这种结构。

正是基于这样的背后复杂因素,开发先进的 AI 模型,才会在数据中心产生大量的电能消耗和碳排放。

(五)科技巨头节电的 " 工程 " 与 " 理论 " 使命

科技巨头的耗电问题,已成为社会各界人士探讨的重要话题,同时也让当事企业面临不少监管和舆论的挑战。

此时的科技巨头们,在承担社会责任的同时,也应承担起工程和理论两端的技术使命,其一是通过已有的 IT 工程方法,进一步降低数据中心的能耗浪费。其二在理论层,研究出更低功耗的芯片,并推动具备推理能力的 AI 基础研究的发展,让技术更精益、更高效。

技术的向善,一种善是赋能,让社会和生活更加美好。而另一种善,是进化,让技术本身变得更加绿色。